导读

真实3D场景的全息获取和重建一直是人们追求的目标,其在工业检测、医疗等诸多领域有着广泛的应用前景。然而,由于3D物体的计算量大,导致全息图的计算速度慢。加上激光相干性的影响,重建像中存在严重的散斑噪声。目前,对于真实3D场景的快速全息获取和高保真重建仍难以实现。

近日,北京航空航天大学王琼华教授团队与上海理工大学庄松林院士和张大伟教授团队合作,提出了一种基于液体透镜的全息相机,用于获取真实3D场景的全息图。该全息相机的硬件模块采用了搭载大孔径液体透镜的液体相机,软件模块使用了一种端到端的物理模型驱动网络(EEPMD-Net)。该工作实现了3D场景真实深度的全息图高保真快速获取。所提出的全息相机解决了现有全息技术中真实3D场景计算速度慢和全息再现像质量低的两大瓶颈问题。相关成果以“Liquid lens based holographic camera for real 3D scene hologram acquisition using end-to-end physical model-driven network”为题发表在国际顶尖学术期刊Light: Science & Applications上。

研究背景

一般来说,在对真实3D场景进行全息重建之前,需要先用相机采集真实3D场景的数据,然后计算真实3D场景的光场分布并编码生成全息图。然而,真实3D场景的数据采集往往需要耗费大量的时间。有研究者提出采用激光主动照明的方法,使用照相机直接捕获真实3D场景的干涉条纹,然而,这对系统的集成化提出了新的挑战。还有研究者利用电润湿液体透镜来实现真实3D场景的快速采集,然而,受液体透镜口径的限制,图像获取质量受到了严重影响。近年来,随着深度学习技术的发展,研究者在高保真全息图的快速生成方面取得了不少进展。然而,目前的研究难以实现真实3D场景全息图的快速计算,且重建质量有待提高。如何实现真实3D场景的全息图快速计算和高保真重建成为了全息领域亟待解决的关键问题之一。

创新研究

鉴于上述问题,研究人员提出了一种基于大孔径电润湿液体透镜的全息相机,并通过使用EEPMD-Net获取真实3D场景的高保真全息图。如图1所示,全息相机的硬件由基于液体透镜的液体相机组成。作为液体相机的核心部件,研究人员通过配制无水溶液,突破了传统电润湿液体透镜的孔径限制,研制出10mm大孔径的电润湿液体透镜,使得液体相机能获得高质量真实3D场景信息。作为全息相机的软件部分,EEPMD-Net可以对真实3D场景的红、绿、蓝全息图进行并行计算,从而在53ms内获得3D场景的高保真全息图。当将全息图加载到空间光调制器上进行重建时,彩色全息再现像的峰值信噪比可达到28dB,实现了真实3D场景的高保真全息再现。

图1 全息相机的结构示意图

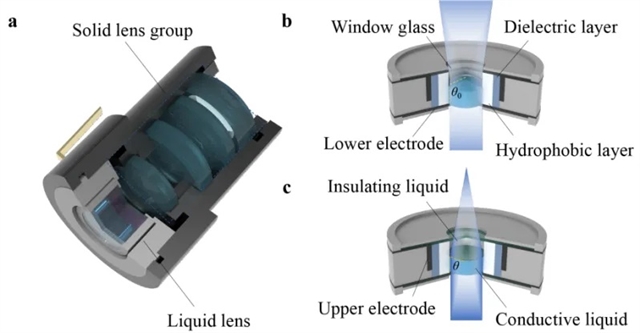

在全息相机中,液体相机由固体透镜组和液体透镜组成,如图2a所示。液体透镜主要由上电极、下电极、导电液体、绝缘液体、两片窗口玻璃和外壳组成。为了实现具有大孔径和高稳定性的液体透镜,研究人员在确保密度匹配的前提下,使用了特殊的溶剂和溶质来调整液体透镜的导电液体和绝缘液体的折射率、密度和粘度,突破了10mm孔径的液体透镜技术。图2b和图2c分别是液体透镜在发散和会聚时的状态示意图。所制作的液体透镜还具有驱动电压低、响应速度快和光焦度变化范围大的特点。

图2 液体相机的结构示意图:a液体相机的结构;b液体透镜为发散状态;

c液体透镜为会聚状态

EEPMD-Net的训练过程如图3所示。与传统的物理模型驱动网络不同,所提出的EEPMD-Net以真实3D场景的全聚焦图像和深度图作为输入信息,采用两种新的编解码网络结构实现低噪声全息图的生成。首先,利用场景融合和深度计算方法,将液体相机拍摄到的多层真实3D场景处理为全聚焦图像和深度图,随后输入到网络Ⅰ中。接着,网络Ⅰ输出真实3D场景的目标振幅场和相位场。然后,基于物理模型将目标振幅场和相位场进行正向衍射传播,以获得空间光调制器上的振幅场和相位场,并输入到网络II中以编码真实3D场景的全息图。最后,利用物理模型反向传播全息图,获得真实3D场景的多个层面的全息再现像。在对多个层面的全息再现像进行深度融合计算后,通过计算深度融合的全息再现像与增强的3D场景之间的损失函数来训练网络Ⅰ和网络II,最终实现红绿蓝三通道全息图的快速生成。

图3 EEPMD-Net的训练过程示意图

该研究成果以“Liquid lens based holographic camera for real 3D scene hologram acquisition using end-to-end physical model-driven network”为题在线发表在Light: Science & Applications。北京航空航天大学的王迪副教授、李赵松博士生为共同第一作者,王琼华教授为通讯作者。(来源:LightScienceApplications微信公众号)

相关论文信息:https://doi.org/10.1038/s41377-024-01410-8

特别声明:本文转载仅仅是出于传播信息的需要,并不意味着代表本网站观点或证实其内容的真实性;如其他媒体、网站或个人从本网站转载使用,须保留本网站注明的“来源”,并自负版权等法律责任;作者如果不希望被转载或者联系转载稿费等事宜,请与我们接洽。